芯片巨头超微半导体公司 (AMD) 和对冲基金 LuminArx Capital Management 为云端初创公司 Vultr 筹集了 3.33 亿美元的增长融资,这表明对人工智能基础设施的需求旺盛。

总部位于佛罗里达州西棕榈滩的 Vultr 表示,目前其估值为 35 亿美元,并计划利用这笔融资购买更多图形处理单元 (GPU),即驱动 AI 模型的芯片。这笔融资是 Vultr 首次注入外部资本。

该公司最初为企业的信息技术系统提供云计算服务,现在也提供人工智能计算服务。Vultr 表示,其人工智能云服务(向客户出租 GPU 访问权限)将很快成为其业务的最大组成部分。

AMD 公司发展首席战略官 Mathew Hein 表示,对于 AMD 来说,这项投资是让“客户通过其平台体验 AMD GPU”的一种方式。“我们将他们视为提升这一代和未来几代 AMD 产能的人才。”

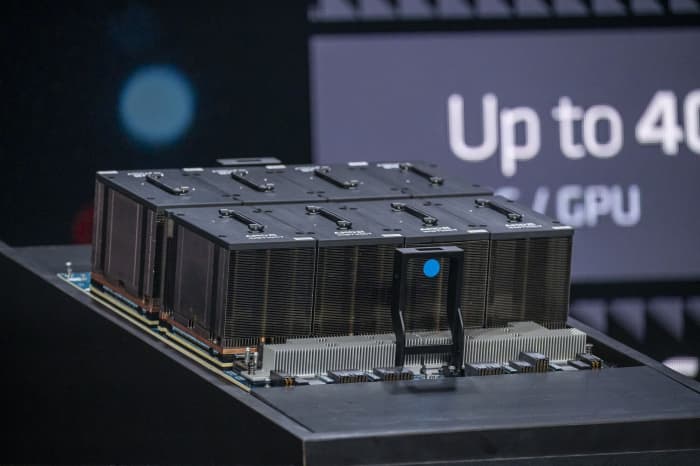

Hein 表示,AMD 的目标是成为 Vultr 的“首选”AI 硬件提供商,但不会强迫用户做出选择。今年早些时候,AMD 发布了最新一代AI 芯片 MI325X,下一代 MI350 芯片将于明年推出。

本月初,Vultr 宣布计划在其芝加哥地区数据中心构建首个采用数千块 AMD GPU 的“超级计算”集群。

此轮融资之前,AI 芯片市场领导者Nvidia也采取了类似的举措。Nvidia与其他投资者一起,于 2023 年向 AI 云提供商 CoreWeave 提供了超过 4 亿美元的资金。CoreWeave 去年还以其 Nvidia GPU 作为抵押获得了 23 亿美元的债务融资。

Nvidia 已将其 GPU 的访问权限扩展到大量云提供商,AMD 也是如此。

研究公司国际数据公司 (International Data Corp.) 云计算和边缘服务研究副总裁戴夫·麦卡锡 (Dave McCarthy) 表示:“AMD 正在想办法与 Nvidia 增强竞争力。对于 AMD 来说,能够与 Vultr 这样的新兴云提供商达成良好的合作,将有助于他们在市场上获得更高的知名度。”

AMD 还投资了 TensorWave 等云提供商,后者也提供 AI 云服务。8 月,AMD 斥资近 50 亿美元收购了数据中心设备设计公司 ZT Systems 。

IDC 预计,到 2027 年底,AI 半导体市场规模将从今年的 1175 亿美元增至 1933 亿美元。据 IDC 称,Nvidia 占据了 AI 芯片市场约 95% 的份额。

Vultr 表示,其云平台为数十万家企业提供服务,包括微软旗下的视频游戏公司动视暴雪和印度电信巨头巴帝电信。

首席执行官 JJ Kardwell 表示,Vultr 的客户还将其已有十年历史的云平台用于其核心 IT 系统。

人工智能芯片市场中不乏挑战英伟达领先地位的竞争对手。除了 AMD,SambaNova Systems 等初创公司以及云计算巨头亚马逊网络服务和谷歌也在寻求为英伟达的硬件提供替代品。

微软、Meta Platforms和甲骨文均表示他们使用 AMD 的 GPU。亚马逊云部门的一位发言人表示,该公司与 AMD 密切合作,并“积极考虑提供 AMD 的 AI 芯片”。

与大多数云平台提供商一样,Vultr 并不只依赖一家 GPU 供应商。卡德威尔表示,该公司向客户提供 Nvidia 和 AMD GPU,并计划继续这样做。他补充道:“市场中不同部分对每家供应商都有不同的评价。”

市场中有一部分使用人工智能模型,而不是训练它们,部署一种称为人工智能推理的过程,需要更快的速度和更大的带宽。卡德威尔说,这发挥了 Vultr 的优势,也是 AMD 的 GPU 价格具有竞争力的领域。

与总部位于新泽西、以加密货币挖矿起家的 CoreWeave 一样,Vultr 也是从芯片制造商那里获得芯片并接受其资助的云计算公司之一。Forrester分析师 Lee Sustar 表示,这两家公司也迅速转向收购 GPU,以满足对生成式 AI 的需求。